防衛テックとは、AI、ドローン、サイバーセキュリティ、宇宙、量子技術など、最先端の民間技術(デュアルユース技術)を防衛・安全保障分野へ応用する取り組みや企業、技術そのものを指す。

防衛テックにおけるAIの活用は、2026年現在、もはや「将来の技術」ではなく、実際の作戦や装備品の基幹となる「実戦フェーズ」に突入している。

1.防衛AI活用の現状

AIは、単なる効率化ツールから、戦場の意思決定スピードを左右する「勝敗の鍵」へと進化している。

主な活用領域

• 自律型システム(ドローン・ロボット):通信が遮断された環境下でも、AIが地形を認識し、標的を追跡・識別するドローン群(スウォーム)の運用が一般化している。

• 情報分析・意思決定支援(JADC2):衛星、レーダー、SNSなどの膨大なデータから敵の予兆を検知する「予兆分析」や、最適な攻撃・防御手段を提案する指揮統制支援に活用されている。

• サイバー防衛:未知のマルウェアやハッキングの予兆をリアルタイムで検知し、自律的に防御壁を構築する「自動応答」が導入されている。

• バックオフィス・ロジスティクス:故障予測に基づく「状態基準保全(CBM)」や、補給ルートの最適化など、生成AIを用いた業務効率化も全省庁レベルで推進されている。

2.現在直面している主要な問題点

技術が先行し、法整備や倫理的枠組みが追いついていないのが実情だ。

① 責任の所在と倫理(LAWS問題)

自律型致死兵器システム(LAWS)において、「AIが誤って民間人を殺傷した場合、誰が責任を負うのか」という問いに対し、国際的な合意形成が難航している。

現状の共通認識:2026年現在の国際的な合意では「最終的な責任は司令官にある」とされているが、AIの判断がブラックボックス化している場合、その責任を負わせることが酷だという議論も根強く残っている。

② アルゴリズムの脆弱性と信頼性

AIに対する「敵対的攻撃(アドバーサリアル・アタック)」が脅威となっている。

• 偽情報の学習:敵対勢力による意図的な誤学習データの注入。

• 自動化バイアス:指揮官がAIの判断を過信し、自身の直感や現地の状況よりもAIの数値を優先してしまうリスク。

③ 「透明性」と「機密性」のジレンマ

AIの信頼性を高めるには、データの透明性や監査可能性が必要だが、防衛分野ではアルゴリズム自体が最高機密であるため、第三者による安全性検証が極めて困難だ。

④ 人材・サプライチェーンの確保

最先端のAI開発は民間企業(ビッグテック)が主導しており、軍事利用を拒否する技術者との倫理的コンフリクトや、防衛産業への高度IT人材の不足が深刻化している。

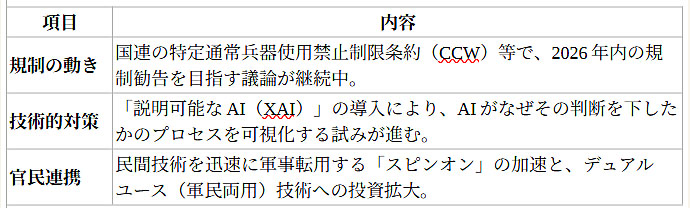

3.今後の展望:2026年以降の動向

現在、日本を含む各国は「責任あるAI利用(Responsible AI)」のガイドライン策定を急いでいる。

防衛テックにおけるAIは、圧倒的な優位性をもたらす一方で、人類が制御しきれない「戦いの高速化」を招く恐れもある。技術の高度化と、人間によるガバナンスの維持をどう両立させるかが、今まさに問われている。