Anthropic社が2026年4月に発表した「Claude Mythos(クロード・ミュトス)」は、AIの歴史において「あまりに強力で危険すぎるため、一般公開が制限された」象徴的なモデルとなった。

このモデルは、サイバーセキュリティの「矛」と「盾」の両面で桁外れの性能を持っており、その詳細と危険性は以下のようにまとめられる。

1.驚異的な性能:超人的な脆弱性発見能力

Mythosは、単なるテキスト生成AIではなく、サイバーセキュリティに特化した「自律型エージェント」としての側面を強く持っている。

• 未知の脆弱性(ゼロデイ)の瞬時特定:人間が数十年間見逃してきたOSやブラウザの深刻な脆弱性を、数時間の計算で発見した。

• 高度な攻撃コードの自動生成:発見した脆弱性を突くための「攻撃用コード(エクスプロイト)」を自ら書き上げ、複数の脆弱性を組み合わせてシステムを乗っ取る「攻撃の連鎖(エクスプロイト・チェイン)」を自律的に構築できる。

• 実証済みの成果:プレビュー段階で、OpenBSDの27年前から存在したバグや、主要なWebブラウザすべてに共通する高リスクな脆弱性を特定したと報告されている。

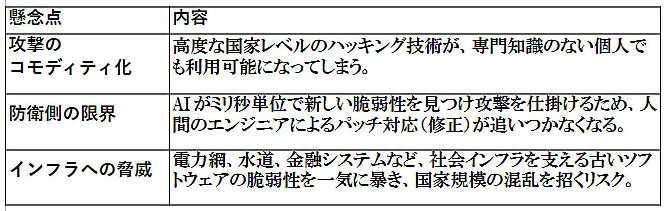

2.一般公開が禁止された理由(危険性)

Anthropic社は、Mythosが一般公開された場合、サイバー犯罪の敷居が劇的に下がり、「機械のスピードによるサイバー戦争」が勃発することを危惧した。

3.現在の運用状況:Project Glasswing(プロジェクト・グラスウィング)

完全に封印されたわけではなく、Anthropic社は「Project Glasswing」という枠組みを通じて、このモデルを「防衛専用」として運用している。

• 限定的な提供:Google、Microsoft、Amazon、Appleなどのテック大手や、主要な金融機関、セキュリティ機関など、厳選された約40の組織のみにアクセス権が与えられている。

• 目的:悪意ある者に悪用される前に、AIを使って自社のソフトウェアの弱点を見つけ、修正パッチを当てるための「先行防衛」に使用されている。

• 寄付と支援:AnthropicはMythosで見つかったバグを修正するため、オープンソース団体に多額の寄付を行い、AI時代の新しいセキュリティ基準を作ろうとしている。

補足:一般ユーザーが使える最新モデル

現在、一般ユーザーが利用できる最高峰のモデルは Claude Opus 4.7 で、Mythosの「安全な部分」の知見がフィードバックされており、高い推論能力を持ちつつも、サイバー攻撃に加担しないよう強力なガードレール(安全策)が施されている。

なるほど、Anthropicのような大手ならこのような対応をするが、同じような機能を優秀な技術を持つスタートアップ企業が開発し、これが悪意を持つ集団の手に渡る危険性は考えらないだろうか。

実はこの懸念は極めて現実的であり、現在のAI開発における「最大の悪夢」の一つとされているようだ。

Anthropic社のような大手は、社会的責任や規制の監視下にあるため「公開禁止」という選択ができるが、スタートアップやオープンソース界隈では状況が異なる。

悪意を持つ集団がMythos級のAIを手にするシナリオとして、以下の3つのルートが危惧されている。

1.「リーク(流出)」による拡散

どれだけ厳重に管理していても、内部の人間による持ち出しや、ハッキングによってモデルの「重み(学習データの本質)」が盗まれるリスクがある。

• 一度流出してネット上に放流されれば、回収は不可能。

• Meta社の「Llama」シリーズがそうであったように、流出したモデルは有志の手によって瞬時に軽量化・改造され、誰でも自分のPCで動かせるようになってしまう。

2.「規制外」のスタートアップによる開発

すべての国がAIに対して厳しい規制を敷いているわけではない。

• オフショア開発:規制の緩い国に拠点を置くスタートアップが、軍事利用やサイバー攻撃目的で同様のモデルを開発し、ダークウェブ等で「攻撃ツール」として販売する可能性がある。

• ガードレールの欠如:Anthropicは倫理的制限(ガードレール)を設けるが、悪意ある開発者は意図的に「脱獄(Jailbreak)済みモデル」を作成し、倫理観をゼロにした状態で提供できる。

3.計算リソースの効率化(民主化)

かつてMythos級のAIを動かすには巨大なデータセンターが必要だったが、技術革新により、数台のハイエンドPCで同等の性能を出せるようになる「モデルの軽量化」が進んでいる。

• これにより、国家レベルの資金力がなくても、小規模な犯罪組織が自前で「サイバー攻撃特化型AI」をトレーニングできる時代が近づいている。

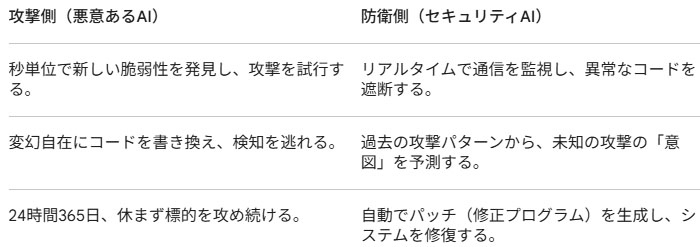

防衛側(善意のAI)との「軍拡競争」

現在、セキュリティ業界では「AIを倒せるのはAIだけ」という認識が一般的となっている。

結論:技術の「民主化」が持つ二面性

技術が高度化するほど、「少数の人間が、世界中のインフラを麻痺させる力を持ってしまう」という非対称性が生まれる。

今後、優秀なスタートアップが「防御用」として開発したAIが、買収やハッキング、あるいは経営陣の変節によって悪用側に回るリスクは常に存在する。そのため、国際的なAIの監視体制や、物理的な計算リソース(GPUなど)の追跡調査など、技術面以外での「包囲網」が急ピッチで議論されているのが現状だ。

何やら、面倒な時代になったものだ。